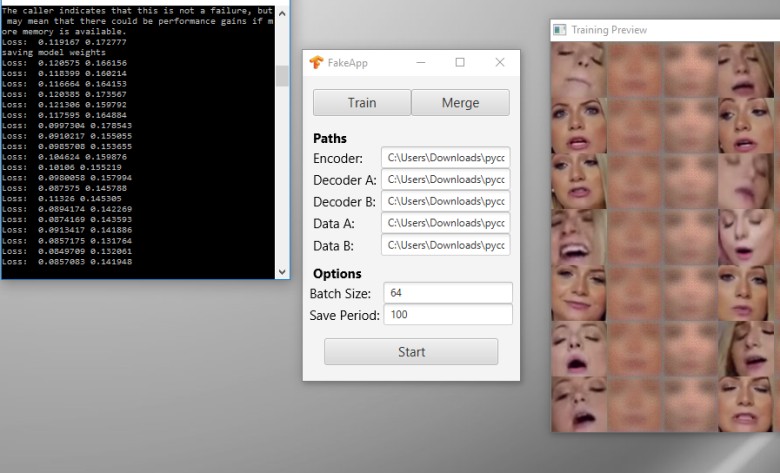

12 января 2018 года пользователь Reddit под ником Deepfakes выпустил программу FakeApp — приложение для замены лиц в видеороликах. За прошедшее время вышло несколько новых версий (текущая версия FakeApp 2.1 вышла 4 февраля) — и программа приобрела жуткую популярность. Количество скачиваний давно превысило 100 000. Особенно она понравилась любителям «клубнички», которые давно хотели увидеть в интересном положении свою любимую актрису или какую-нибудь другую целомудренную знаменитость.

Поддельные видеоролики с лицами знаменитостей получили настолько широкое распространение, что популярным видеохостингам пришлось принимать меры. Первым запрет на фейковые видеоролики ввёл известный сайт Pornhub — гигант мирового порно с посещаемостью 75 млн человек в день.

«Пользователи начали помечать такой контент, и мы удаляем его как только появляются жалобы, — сказал вице-президент Pornhub Кори Прайс (Corey Price) в комментарии Mashable. — Мы призываем всех, кто сталкивается с этой проблемой, посетить нашу страницу удаления контента, чтобы официально подать запрос».

Позже представители Pornhub уточнили свою позицию. В комментарии для Motherboard они сказали, что расценивают это как форму порно без согласия актрисы. А на сайте всегда блокировались любые типы видеороликов, когда участник явно не согласен на происходящее. Теперь к такого рода контенту отнесены и сгенерированные ИИ видеоролики с чужими лицами.

Хотя Pornhub формально запретил порно со знаменитостями, но в реальности на сайт ежедневно закачиваются десятки таких видеороликов. А скоро их качество повысится настолько, что станет очень трудно отличить: это реальное видео со знаменитостью или поддельное.

Deepfakes впервые показал результаты работы своей программы в декабре 2017 года. Тогда он ещё не выложил её в открытый доступ. Автор рассказывал, что наложение лиц осуществляется системой на основе нейронной сети, которая разработана с использованием различных свободных библиотек и фреймворков. В основном он сделал программу с помощью библиотеки Keras на бэкенде TensorFlow. Для обучения нейросети и составления подборки лиц знаменитостей достаточно поиска по изображениям Google, стоковых фотографий и видео с YouTube.

Структура нейросети похожа на ту, которая описана в научной работе исследователей из Nvidia. Их алгоритм может, например, в реальном времени менять погоду на видео.

Чтобы подделать лицо конкретной знаменитости, нужно обучать нейросеть конкретно на её видео и на порнороликах. После обучения программа способна подменять лицо на лету. В подреддите /r/deepfakes/ уже опубликованы тысячи таких видеороликов.

На видеокарте потребительского уровня обучение занимает несколько часов, на CPU может продолжаться несколько суток. Для работы нужна установленная среда CUDA 8.0. Обучение нейросетей уже давно стало доступной технологией, поиграться с которой может даже подросток.

Интересно, что кто-то может воспользоваться этой программой, чтобы скомпрометировать знакомую девушку и парня. Программе требуется два набора из нескольких сотен кадров с двумя лицами, которые будут заменяться. Кадры извлекаются из видеороликов командой ffmpeg -i scene.mp4 -vf fps=[FPS OF VIDEO]. Затем нужно в программе указать путь к папкам с «моделями» — и продолжать обучение до тех пор, пока окно предварительного просмотра не начнёт показывать удовлетворительный результат.

Многие люди добровольно выкладывают в социальные сети сотни фотографий и видеоролики со своим лицом. Этого будет достаточно для обучения нейросети.

Известные порнозвёзды отрицательно высказались по поводу использования этой программы и распространения поддельных видеороликов. Например, актриса Грейс Эванджелин (Grace Evangeline) сказала, что в индустрии всегда действует одно важное правило — согласие. А в данном случае осуществляется съёмка со знаменитостями без их согласия, что неправильно. Не говоря уже о том, что одновременно используется тело другой актрисы тоже без её согласия.

Специалисты по машинному зрению и Искусственному Интеллекту, считают, что подделка видео и фотографий поднимает серьёзные этические проблемы — поэтому следует поднять широкое общественное обсуждение на эту тему. Все должны знать, насколько легко подделать видео с чужим лицом. Раньше такое было доступно только профессионалам, обладающих мощными ресурсами. А сейчас это может сделать любой программист-одиночка.

Возможно, в будущем придётся изменить законодательство, чтобы защищать неприкосновенность не только физического тела человека, но и его цифровой личности и виртуального образа. За насильственные действия с виртуальным образом человека без согласия этого человека, возможно, тоже введут ответственность.

Источник:https://geektimes.ru/post/297971/

, это уже как то подозрительно звучит)

, это уже как то подозрительно звучит)

За оценку статьи в ленте (лайк или дизлайк)

За оценку статьи в ленте (лайк или дизлайк)  Ответить в теме на форуме

Ответить в теме на форуме  Новый пользователь

Новый пользователь

Комментарии

RSS лента комментариев этой записи